本篇文章1211字,读完约3分钟

雷锋。(公开号码:雷锋。人工智能科技评论出版社:2017年8月20日,语音通信领域的国际顶级学术会议“2017种间技术”在瑞典斯德哥尔摩举行。腾讯音像实验室王焱楠博士的论文被选中并应邀在会上做口头报告。

Interspeech是由ISCA(国际语音通信协会)组织的语音研究领域的顶级会议之一,是语音信号处理领域世界上最大的综合性科技盛会。该会议每年举行一次,每次都吸引全球语音信号和人工智能领域的著名学者、企业和R&D人员。

在今年的展会上,除了学术巨头,国内外知名企业包括苹果、谷歌、微软、亚马逊、腾讯、阿里巴巴、百度、滴滴等。腾讯音像实验室博士论文《基于深度神经网络的非线性谱映射最大似然方法用于单通道语音分离》入选2017年国际科技期刊。

下图显示了这些年来种间技术论文的收集情况。过去三年收集的文章数目分别为614,746及779篇。

王博士论文的主要内容是研究深度神经网络在单通道语音分离中的训练优化问题。该技术旨在将目标说话人的语音从多个说话人的混合语音信号中分离出来,在语音识别、语音呼叫和残疾人助听器中有着重要的应用。

在本文中,王博士的研究主要集中在改进最小均方误差(mmse,最小均方误差)上,这是一种常用的基于深度神经网络的频谱映射方法,用于单通道语音的分离和总结。在基于深层神经网络的单通道语音分离中,主要基于最小均方误差准则,利用多类回归法从混合语音频谱中恢复出目标说话人的语音,以使网络输出的语音频谱与目标频谱之间的差异最小。对此,王博士等人通过对深层神经网络输出预测误差的统计分析,发现输出对数功率谱的每个一维分量都服从单峰分布,如下图所示:

因此,引入零均值的高斯分布函数来描述神经网络的预测误差向量,并引入概率分布的学习,利用最大似然估计方法来训练深层神经网络的参数,如下图所示。

通过实验比较,发现基于最大似然法训练的神经网络分离出的语音在不同的客观指标上超过了传统最小均方误差准则训练的神经网络。

另外,通过对比验证集上重构损失的变化,王博士等人发现该模型具有较强的泛化能力,并且该方法在收敛速度上也有明显的优势,如下图所示。

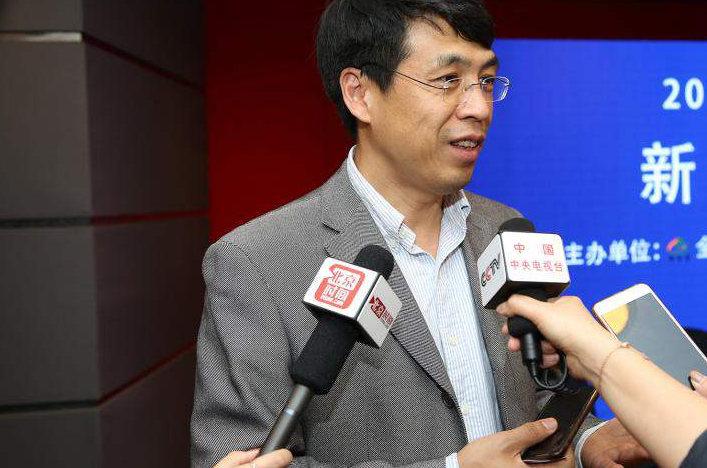

关于王焱楠博士

王焱楠毕业于中国科技大学语音信号与信息处理国家工程实验室。他的研究领域包括语音增强和分离、语言识别、手写识别等。他在著名的国际语音会议上发表了许多文章,如《音频、语音和语言处理》杂志上的interspeech和IEEE Transaction,并对无监督语音分离方法做出了重要贡献。王博士于2017年加入腾讯音视频实验室,专注于语音增强和分离等前端信号处理。

关于腾讯音像实验室

腾讯音视频实验室成立于2016年11月,专注于音视频通信技术的前瞻性研究,包括全球实时音视频网络优化、音视频编解码前沿算法研究、计算机视觉图像处理、基于人工智能的音视频增强、声音美化和音视频质量评价等。

雷锋文章版权所有。严禁擅自转载。详情请参考转载说明。

标题:腾讯论文入选Interspeech 2017:在单通道语音分离中应用的深度神经网路的训练优

地址:http://www.hcsbodzyz.com/hcxw/6176.html